正常狀態下,人在說話時心理情感的波動會引起聲壓、語氣、語速、停頓時間和發聲器官的微小變化,以及通過人體大腦皮層的生理反應,利用心理學、生理學、神經科學、信號分析處理、人工智能等的諸多前沿科技,檢測分析語音中某些特征參數的變化,因此,檢信智能通過監測這些特征變化實現心理情感分析。

根據當前語音情感分析的不足,檢信智能通過多年語音情感識別技術的開發經驗,結合循環神經網絡具有記憶性、參數共享等特征,對序列的非線性特征在學習方面具有一定優勢,利用基于LSTM(LongShort-Term Memory)長短期記憶網絡,將一種時間循環神經網絡,應用于處理和預測時間序列中間隔和延遲相對較長的重要事件,解決長序列訓練過程中的梯度消失和梯度爆炸問題。相比普通的RNN,LSTM能夠在更長的序列中有更好的表現,通過將卷積操作引入長短時記憶網絡中,構建完整的語音心理情感網絡模型,將語音進行統一歸一化處理,再對統一歸一化處理的語音進行分割之后,對割分的語音加窗分幀處理,并建立變長數據的計算方式,將卷積操作引入長短時記憶網絡中,實現完整的語音情感識別網絡模型,并識別平靜、高興、吃驚、悲傷、憤怒、厭惡和恐懼7種情感功能。

目前市場上語音心理情感分析存在如下:

(1)心理情感與語音特征的邏輯關系不夠明確;

(2)從語音數據采集到語音特征的提取降噪處理不夠導致信息的損失,而損失的信息影響最終心理情感檢測的 效果;

(3)分類算法效果一定程度上依賴人為提取的語音特征,算法本身不具有特征學習能力。

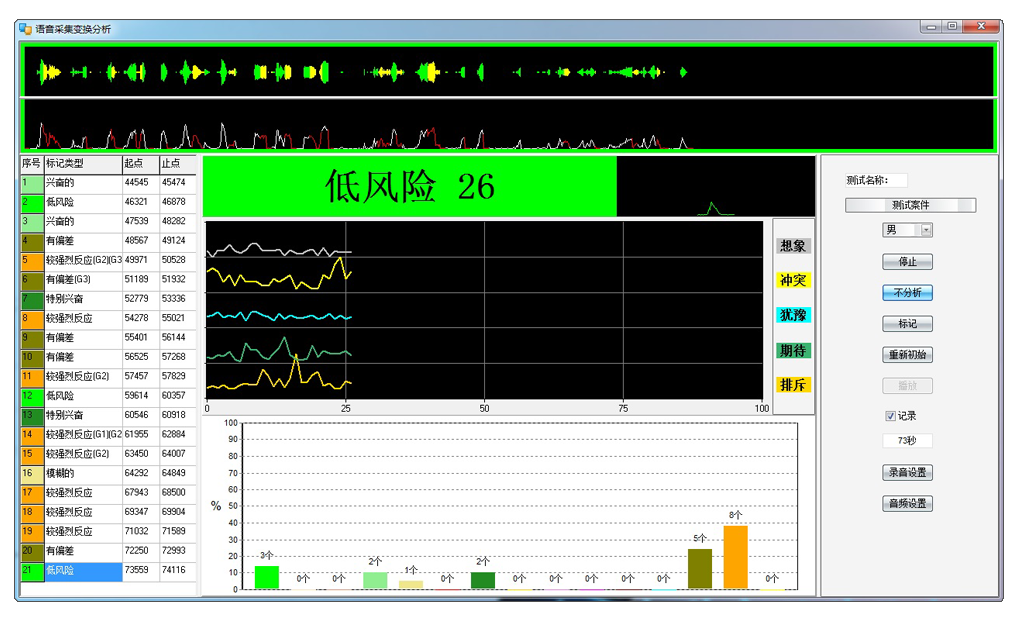

根據語音情感數據,檢信Allemotion平臺根據特有的情緒建模及神經網絡獲得被測試者每一時刻或在說話片段中的害怕、排斥、沖突、期待、壓力、興奮、邏輯、比率、概率、分心、猶豫、認知、緊張、壞感、想象、思考、潛意識、潛在情緒。

(1)系統的識別時延低于250ms。

因為在線語音情感識別,如果時延過高不但影響用戶體驗,而且對后續的語音情感識別請求的處理時間就更加長,發生堵塞。時延低是系統最重要的要求,要求系統對每個語音情感識別的請求處理時間低于250ms。

(2)能夠處理大規模并發任務請求。檢信ALLEMOTION語音情感識別具有并發任務處理能力。如果對語音情感識別任務的處理是串行的,則依然滿足不了大規模的應用。

(3)利用采集針對性的語料進行模型訓練,并在引擎模塊中語音情感特征提取前加入語音降噪處理步驟,提高了情感識別率。原始語音信號從頻譜圖上可以看到語音數據中含有一些不規則信號的噪聲。下圖是經過降噪之后的語音信號變得有規律,可以發現降噪效果還是明顯的。經過降噪之后重新訓練,明顯提高模型的效果,說明經過降噪的語音有效降低環境噪聲和設備底噪對語音情感識別的影響。

(4) 采用群體決策優化神經網絡方法。

檢信ALLEMOTION采用群體決策的方法將訓練集按照不同的組合條件,并選出每次交叉驗證在測試集上識別效果最好的模型組成一個神經網絡群,當進行識別時,神經網絡群中的每個模型分別對當前樣本進行判斷給出情感標簽,最后使用投票的方式給出最終識別結果。

(5)語音情感識別精度達到達到82%

(6)檢信ALLEMOTION語音情感識別工作穩定性達到99.5% ,運行可靠且有能力處理大規模并發任務。